|

Getting your Trinity Audio player ready...

|

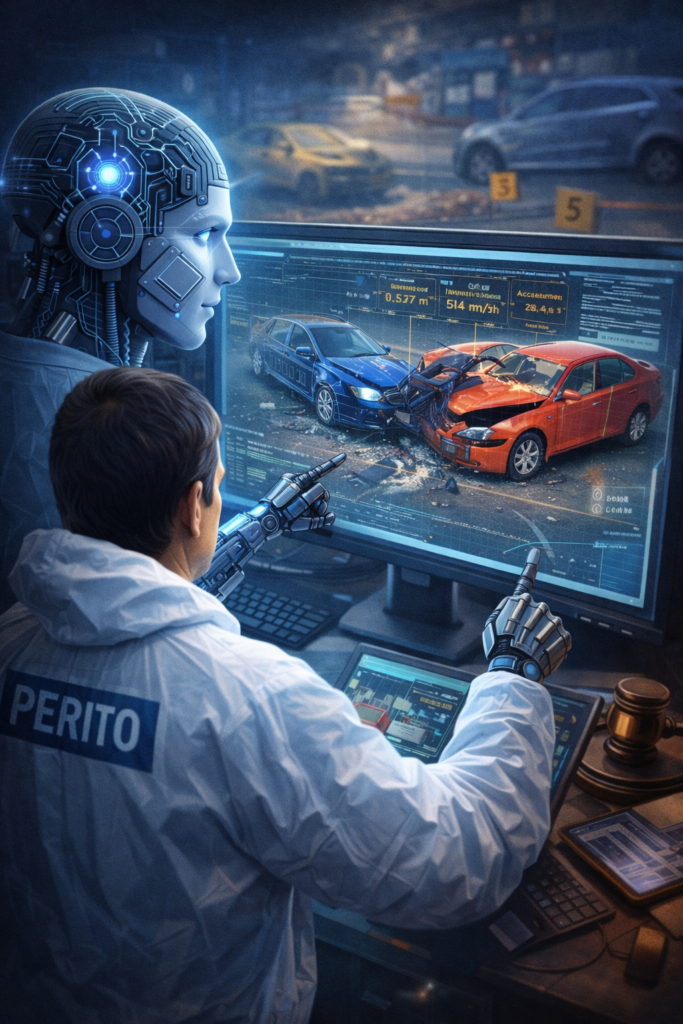

Los desafíos técnicos, metodológicos y éticos que plantea la IA en reconstrucciones periciales tridimensionales

En un artículo anterior analizamos los avances de la inteligencia artificial aplicada al modelado, animación y simulación dentro del mundo 3D, así como sus limitaciones actuales y perspectivas futuras. Sin embargo, cuando trasladamos esas capacidades al ámbito de las reconstrucciones periciales tridimensionales, el escenario cambia significativamente.

En contextos judiciales y técnicos, no basta con que una herramienta sea rápida o visualmente impactante: debe ser precisa, verificable y metodológicamente sólida. Aquí es donde el uso de IA orientada al 3D enfrenta desafíos particularmente sensibles.

Del entorno creativo al entorno probatorio

En producción audiovisual o videojuegos, un pequeño error geométrico puede pasar inadvertido. En una reconstrucción pericial, ese mismo error puede alterar una trayectoria, crear discrepancias con un cálculo de velocidad, afectar un punto de impacto, modificar una línea de visibilidad, entre otras.

La IA generativa está diseñada para producir resultados plausibles, no necesariamente exactos. Y en el ámbito pericial, la plausibilidad no es suficiente.

Precisión geométrica y fidelidad métrica

Uno de los principales desafíos es la precisión dimensional. Las herramientas de IA para modelado 3D suelen generar mallas optimizadas visualmente pero no métricamente exactas, introducir pequeñas deformaciones en proporciones, crear topologías limpias pero no fieles a medidas reales.

En una reconstrucción técnica, donde se trabaja con escalas reales, distancias verificadas y ángulos medidos, cualquier desviación puede comprometer la validez del trabajo.

La pregunta clave es: ¿Cómo garantizar que un modelo generado o asistido por IA respete exactamente los datos empíricos recolectados?

Transparencia y trazabilidad del proceso

En el ámbito judicial, no solo importa el resultado, sino también el proceso. Una reconstrucción debe poder explicar qué datos se utilizaron, cómo se procesaron, qué supuestos se adoptaron, qué cálculos se aplicaron.

Las herramientas de IA, especialmente las basadas en modelos entrenados con grandes volúmenes de datos, suelen funcionar como sistemas parcialmente opacos. Esto genera un problema: Si la IA interviene en la generación de geometría, animación o simulación, ¿Cómo se documenta técnicamente su participación?

La falta de trazabilidad puede debilitar la fuerza probatoria de la reconstrucción.

Interpretación versus inferencia automática

Una reconstrucción pericial no es una creación artística (aunque pueda contener aspectos de ella); es una representación técnica basada en evidencia.

La IA tiende a completar información faltante mediante inferencias estadísticas. En cambio, el perito trabaja con datos concretos, mediciones verificadas, declaraciones contrastadas, evidencia física documentada.

El riesgo aparece cuando la IA “rellena” vacíos con estimaciones no fundamentadas explícitamente. En un juicio, esa diferencia puede ser crítica.

Simulación física y validación científica

En el artículo anterior mencionamos los avances en simulaciones físicas asistidas por IA. No obstante, en reconstrucciones periciales es indispensable que los modelos físicos estén basados en leyes comprobadas, los parámetros sean justificables, los resultados puedan replicarse.

Si una IA ajusta dinámicas automáticamente (colisiones, deformaciones, trayectorias), el perito debe poder explicar y defender esos parámetros.

La automatización no puede reemplazar la validación técnica.

Riesgo de sobreconfianza tecnológica

La sofisticación visual puede generar un efecto psicológico poderoso: cuanto más realista se ve una simulación, más convincente parece.

Sin embargo, realismo visual no equivale a exactitud técnica. La fluidez de animación no implica fidelidad dinámica. La alta calidad gráfica no garantiza rigor metodológico. Existe el riesgo de que tribunales o terceros otorguen mayor peso a una reconstrucción simplemente por su apariencia, sin analizar críticamente su base técnica.

Marco ético y responsabilidad profesional

El uso de IA en pericias introduce nuevas responsabilidades: ¿Hasta qué punto puede automatizarse el proceso? ¿Debe declararse explícitamente el uso de IA? ¿Quién responde ante un error generado por un sistema automatizado?

El perito sigue siendo responsable del informe. Por ello, la IA debe entenderse como herramienta de apoyo, no como sustituto del criterio profesional.

¿Qué puede aportar realmente la IA hoy en reconstrucciones?

A pesar de los desafíos, la IA sí puede aportar valor cuando se utiliza de forma controlada, optimizando flujos de modelado inicial, a través de la limpieza de mallas escaneadas, mediante automatización de tareas repetitivas o con el análisis preliminar de escenarios complejos. La etapa final de validación y ajuste permanezca bajo control técnico humano.

Perspectivas futuras: hacia una IA verificable

El futuro probablemente no sea una IA que reemplace al perito, sino una IA que trabaje con datos métricos certificados, que genere reportes automáticos auditables, que integre simulaciones físicamente fundamentadas, que permita exportar registros detallados del proceso.

El desafío no es solo tecnológico, sino también normativo y metodológico. Será necesario desarrollar estándares específicos para el uso de IA en reconstrucciones periciales, asegurando que su incorporación fortalezca —y no debilite— la confiabilidad del trabajo técnico.

La inteligencia artificial aplicada al 3D ha demostrado avances notables en creatividad, velocidad y automatización. Sin embargo, cuando se traslada al terreno de las reconstrucciones periciales tridimensionales, surgen exigencias adicionales: precisión métrica, trazabilidad, validación científica y responsabilidad ética.

El futuro no depende de cuánto pueda generar la IA, sino de cómo se integre dentro de un marco técnico riguroso. En el ámbito pericial, la pregunta no es si la IA puede hacerlo, sino si puede hacerlo con el nivel de exactitud, transparencia y respaldo metodológico que exige la justicia.